|

(5.1) |

|

(5.1) |

| (5.2) |

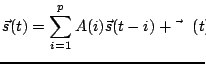

Na podstawie macierzy ![]() można obliczyć macierz gęstości

widmowej zawierającą widma mocy dla pojedynczych kanałów jak również

funkcje wzajemnej gęstości mocy pomiędzy kanałami.

Stosując tego typu podejście, w którym

wszystkie sygnały generowane przez

pewien proces są rozpatrywane jednocześnie,

można policzyć z macierzy spektralnej

nie tylko koherencje zwykłe pomiędzy dwoma kanałami,

ale również koherencje

wielorakie opisujące związek danego kanału z pozostałymi i koherencje

cząstkowe opisujące bezpośrednie związki między dwoma kanałami po usunięciu

wpływu pozostałych kanałów. W przypadku gdy pewien kanał 1 będzie wpływał na

kanały 2 i 3, obliczając koherencję zwykłą znajdziemy związek między 2 oraz 3,

chociaż nie są one ze sobą bezpośrednio powiązane, natomiast koherencja

cząstkowa nie wykaże związku między nimi.

można obliczyć macierz gęstości

widmowej zawierającą widma mocy dla pojedynczych kanałów jak również

funkcje wzajemnej gęstości mocy pomiędzy kanałami.

Stosując tego typu podejście, w którym

wszystkie sygnały generowane przez

pewien proces są rozpatrywane jednocześnie,

można policzyć z macierzy spektralnej

nie tylko koherencje zwykłe pomiędzy dwoma kanałami,

ale również koherencje

wielorakie opisujące związek danego kanału z pozostałymi i koherencje

cząstkowe opisujące bezpośrednie związki między dwoma kanałami po usunięciu

wpływu pozostałych kanałów. W przypadku gdy pewien kanał 1 będzie wpływał na

kanały 2 i 3, obliczając koherencję zwykłą znajdziemy związek między 2 oraz 3,

chociaż nie są one ze sobą bezpośrednio powiązane, natomiast koherencja

cząstkowa nie wykaże związku między nimi.

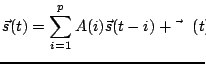

Macierz ![]() jest niesymetryczna, a jej wyrazy pozadiagonalne mają

sens przyczynowości Grangera, co oznacza, że uwzględnienie wcześniejszej

informacji zawartej w jednym z sygnałów zmniejsza błąd predykcji drugiego

sygnału. Opierając się na tej własności zdefiniowano

Kierunkową Funkcję

Przejścia (DTF, directed transfer function) jako znormalizowany element pozadiagonalny

jest niesymetryczna, a jej wyrazy pozadiagonalne mają

sens przyczynowości Grangera, co oznacza, że uwzględnienie wcześniejszej

informacji zawartej w jednym z sygnałów zmniejsza błąd predykcji drugiego

sygnału. Opierając się na tej własności zdefiniowano

Kierunkową Funkcję

Przejścia (DTF, directed transfer function) jako znormalizowany element pozadiagonalny ![]() .

DTF opisuje kierunek propagacji i skład widmowy rozchodzących się sygnałów.

.

DTF opisuje kierunek propagacji i skład widmowy rozchodzących się sygnałów.

Otrzymamy w ten sposób

całościowy opis zmian wszystkich sygnałów jednocześnie.

Co ciekawe, obliczona na tej podstawie funkcja charakteryzująca zależności

między sygnałami ![]() (funkcja przejścia)

nie jest symetryczna, w przeciwieństwie do np. korelacji. Dzięki temu

może służyć wnioskowaniu nie tylko o sile zależności między poszczególnymi sygnałami

składowymi, ale też o kierunku przepływu informacji między nimi.

W przybliżeniu odpowiada to informacji, w którym z sygnałów struktury

odpowiadające danej częstości pojawiają się wcześniej.

(funkcja przejścia)

nie jest symetryczna, w przeciwieństwie do np. korelacji. Dzięki temu

może służyć wnioskowaniu nie tylko o sile zależności między poszczególnymi sygnałami

składowymi, ale też o kierunku przepływu informacji między nimi.

W przybliżeniu odpowiada to informacji, w którym z sygnałów struktury

odpowiadające danej częstości pojawiają się wcześniej.